2016-2022 All Rights Reserved.平安财经网.复制必究 联系QQ 备案号:

本站除标明“本站原创”外所有信息均转载自互联网 版权归原作者所有。

邮箱:toplearningteam#gmail.com (请将#换成@)

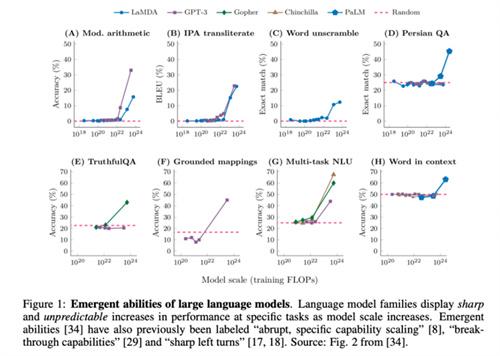

斯坦福大学的研究者对于LLM涌现能力这一说法有一定的质疑,认为这是人为进行选择度量方式最终所产生的结果,涌现是指在小模型当中不存在,而出现在大规模模型当中的一种能力,没有那么多的奇迹会出现。

根据斯坦福大学研究者最新的研究情况,大模型的涌现能力和任务在评价方面指标设置的强度有一定的关系而不是在特定任务和规模下模型行为所发生的一种基本性质的变化,将一些指标变得更为连续和平滑之后,涌现的这种现象就不会十分明显而适合现行更为接近。

涌现能力首先是在GPT-3这一个家族系列当中发现,在后续的工作过程中,对于这一发现再次做出了强调,表示特定的任务上有一些性能在规模上有时是比较难预测的涌现,这种涌现出来的能力让人感觉到较为惊讶。所以突然特定出线的能力方面的扩展也被认为是大型语言模型其中的两个定义的特征其中之一。

斯坦福大学研究者对于特定任务中输出作为模型规模的函数涌现性以及不可预测的变化作出了质疑,在模型组出现错误率的情况,跟随着模型规模的增加会更为持续平滑并且发生可以预测到的一些变化,看似突然出现了一些不可预测的尖锐程度的变化,很可能是研究者在测量方法上选择的不同引起的现象。

这就意味着表现这种能力可能是一种虚假的情况,一部分原因是因为在测试数据上拥有太少,对于较小模型的性能不能够准确地做出估计,另一部分原因是因为对于大规模的模型过少的做出了估计。

2016-2022 All Rights Reserved.平安财经网.复制必究 联系QQ 备案号:

本站除标明“本站原创”外所有信息均转载自互联网 版权归原作者所有。

邮箱:toplearningteam#gmail.com (请将#换成@)